Introduction

L’IA Act ne se contente pas de réglementer les aspects techniques et sécuritaires des systèmes d’IA. Il porte une attention particulière à l’impact de ces technologies sur les droits fondamentaux des personnes. Notamment le droit à la non-discrimination, le droit au respect de la vie privée, le droit à la liberté d’expression ou encore le droit à un recours effectif.

Parmi les mécanismes prévus par l’IA Act pour garantir le respect de ces droits, l’analyse d’impact sur les droits fondamentaux (AIDF) occupe une place centrale. Nous explorerons en détail les objectifs, le champ d’application, le contenu, la méthodologie et les suites à donner à cette analyse.

Obligation pour les intégrateurs Publics et Certains Acteurs Privés

L’obligation de réaliser une analyse d’impact sur les droits fondamentaux ne concerne pas tous les systèmes d’IA, ni tous les acteurs. Elle s’applique aux intégrateurs de systèmes d’IA à haut risque qui sont :

- Des organismes du secteur public ou des personnes morales de droit privé fournissant des services publics ;

- Des opérateurs de services essentiels (entités publiques ou privées) dans les secteurs de l’eau, du chauffage, de l’électricité, du transport routier, ferroviaire, aérien et par voie navigable, ainsi que les opérateurs de services d’infrastructures numériques ; ou

- Des entités privées utilisant des systèmes d’IA à haut risque pour évaluer la solvabilité des personnes physiques ou établir leur cote de crédit, ou pour évaluer et classer les demandes d’assistance sociale.

Organismes publics

La notion d’organisme public est définie largement dans l’IA Act. Elle couvre non seulement les autorités étatiques, régionales et locales. Mais aussi les organismes de droit public et les associations formées par une ou plusieurs de ces autorités ou organismes.

Analyse approfondie : L’inclusion des organismes publics dans le champ d’application de l’AIDF est cruciale. Car ce sont eux qui fournissent de nombreux services essentiels aux citoyens. Et qui prennent des décisions importantes ayant un impact sur leurs vies. L’utilisation de systèmes d’IA à haut risque par ces acteurs doit donc être soumise à un contrôle strict en termes de respect des droits fondamentaux.

Entités privées fournissant des services publics

L’obligation de réaliser une AIDF s’étend aux personnes morales de droit privé qui fournissent des services publics. C’est-à-dire des services d’intérêt général, qui sont soumis à des obligations spécifiques de service public. Et sur lesquels une autorité publique exerce une influence dominante, directement ou indirectement.

Exemple concret : Une entreprise privée qui gère un service de transport public pourrait être considérée comme un fournisseur de services publics. Une clinique privée qui fournit des soins de santé dans le cadre d’un système d’assurance maladie public aussi. Ou une université privée qui délivre des diplômes reconnus par l’État.

Services bancaires et d’assurance (cas spécifiques)

L’IA Act prévoit une obligation spécifique d’analyse d’impact pour les services bancaires et d’assurance. Lorsque ceux-ci utilisent des systèmes d’IA à haut risque pour évaluer la solvabilité de personnes physiques ou établir leur cote de crédit. Ou pour évaluer et classer des demandes d’assistance sociale.

Analyse approfondie : Cette disposition vise à encadrer l’utilisation de l’IA dans des domaines particulièrement sensibles. Où les décisions prises peuvent avoir un impact majeur sur la vie des personnes. Et sur leur accès à des ressources essentielles. Elle reflète la préoccupation du législateur européen quant aux risques de discrimination et d’exclusion.

Opérateurs de services essentiels

L’obligation d’analyse d’impact s’étend aussi aux opérateurs de services essentiels, qu’ils soient publics ou privés. Ces opérateurs sont définis comme des entités qui fournissent des services dont le maintien est essentiel au fonctionnement de la société ou de l’économie. L’IA Act liste explicitement les secteurs suivants :

- Eau

- Chauffage

- Électricité

- Transport routier

- Transport ferroviaire

- Transport aérien

- Transport par voie navigable

- Services d’infrastructures numériques

Analyse approfondie : L’inclusion des opérateurs de services essentiels dans le champ de l’AIDF souligne l’importance de garantir la sécurité, la fiabilité et la résilience des infrastructures critiques. Celles-ci sont de plus en plus souvent gérées à l’aide de systèmes d’IA. Une défaillance ou une utilisation inappropriée de ces systèmes pourrait avoir des conséquences majeures sur la société.

Exceptions

L’obligation de réaliser une analyse d’impact ne s’applique pas lorsque les organisations utilisent les systèmes d’IA à haut risque à des fins exclusivement militaires. De défense ou de sécurité nationale. Quel que soit le type d’entité qui effectue ces activités.

De plus, elle ne s’applique pas aux établissements de crédit réglementés qui sont des PME. Lorsqu’ils utilisent des systèmes d’IA à haut risque pour évaluer la solvabilité de personnes physiques ou établir leur cote de crédit.

Objectifs de l’Analyse d’Impact

L’analyse d’impact sur les droits fondamentaux vise plusieurs objectifs interdépendants.

Identifier les risques spécifiques pour les droits fondamentaux

Le premier objectif de l’AIDF est d’identifier les risques spécifiques. Ceux que l’utilisation du système d’IA à haut risque peut engendrer pour les droits fondamentaux des personnes concernées. Il ne s’agit pas d’une évaluation générale des risques. Mais d’une analyse ciblée sur les impacts potentiels en termes de droits humains.

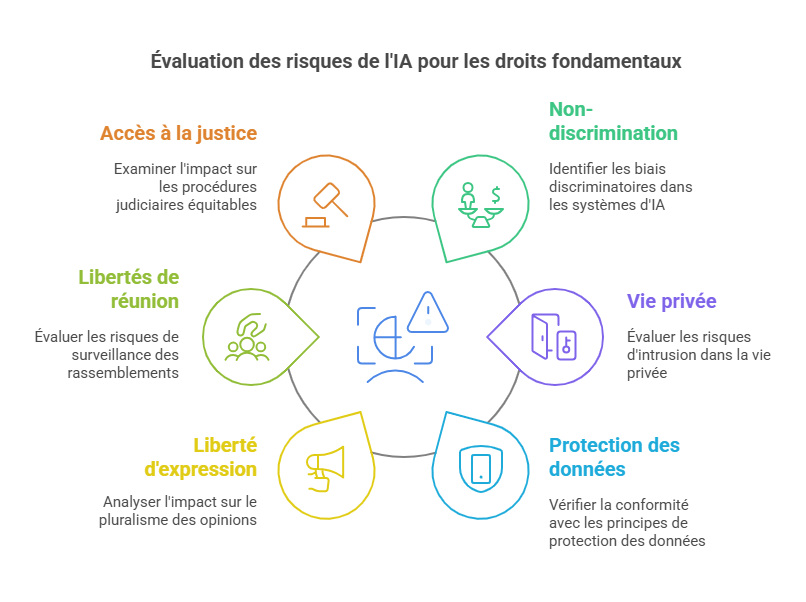

Analyse approfondie : L’identification des risques doit prendre en compte l’ensemble des droits fondamentaux potentiellement affectés. Tels que le droit à la non-discrimination, le droit au respect de la vie privée et familiale, le droit à la protection des données personnelles. Mais aussi le droit à la liberté d’expression et d’information, le droit de réunion et d’association. Sans oublier le droit à un recours effectif et à un procès équitable, le droit à la dignité humaine, les droits de l’enfant, les droits des personnes handicapées, etc. La liste des droits fondamentaux pertinents peut varier selon le contexte et la finalité du système d’IA.

Évaluer la nécessité et la proportionnalité du système d’IA

L’AIDF doit permettre de justifier le recours au système d’IA à haut risque. Au regard des principes de nécessité et de proportionnalité. Il s’agit de démontrer que l’utilisation du système est indispensable pour atteindre les objectifs poursuivis. Qu’il n’existe pas d’alternative moins intrusive pour les droits fondamentaux. Et que les avantages du système l’emportent sur ses inconvénients potentiels.

Exemple concret : Une administration envisage d’utiliser un système de reconnaissance faciale pour contrôler l’accès à un bâtiment public. Elle devra démontrer dans l’AIDF que cette mesure est nécessaire pour assurer la sécurité du bâtiment. Qu’il n’existe pas de moyen moins intrusif d’atteindre cet objectif (par exemple, un contrôle d’accès par badge). Et que les bénéfices en termes de sécurité l’emportent sur les risques d’atteinte à la vie privée et à la liberté de circulation.

Définir des mesures d’atténuation des risques

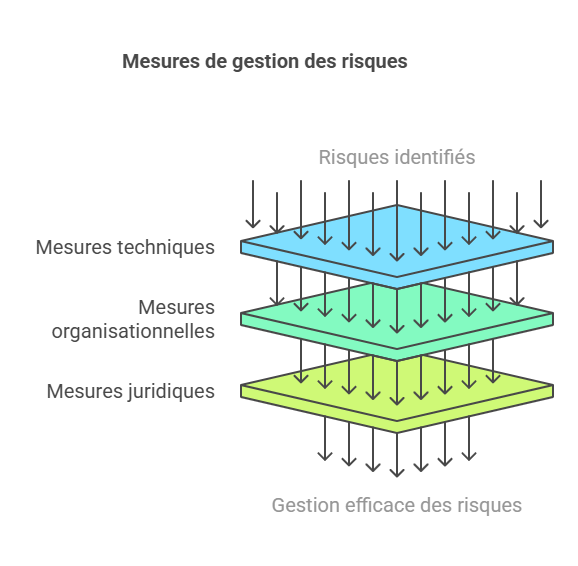

Lorsque l’AIDF identifie des risques pour les droits fondamentaux, elle doit proposer des mesures d’atténuation appropriées. Pour les prévenir ou les minimiser. Ces mesures peuvent être d’ordre technique, organisationnel ou juridique.

Conseil pratique : Les mesures d’atténuation doivent être concrètes, spécifiques et adaptées aux risques identifiés. L’AIDF doit décrire ces mesures de manière précise, planifier leur mise en œuvre et en assurer la documentation.

Impliquer les parties prenantes concernées

L’IA Act encourage les intégrateurs à associer les parties prenantes concernées à la réalisation de l’analyse d’impact. Notamment les représentants des groupes de personnes susceptibles d’être affectées par le système d’IA. Les organisations de défense des droits fondamentaux, les experts indépendants et les partenaires sociaux.

Analyse approfondie : L’implication des parties prenantes est essentielle pour garantir la pertinence et la qualité de l’AIDF. Elle permet de recueillir des points de vue diversifiés sur les impacts potentiels du système d’IA. D’identifier des risques qui auraient pu être négligés par l’intégrateur . Et de proposer des mesures d’atténuation plus efficaces et plus acceptables. Elle contribue aussi à renforcer la légitimité et la transparence du processus décisionnel.

Documenter le processus décisionnel et justifier les choix effectués

L’AIDF doit permettre de documenter l’ensemble du processus d’évaluation des risques. Et de prise de décision concernant l’utilisation du système d’IA. Elle doit justifier les choix effectués par l’intégrateur. Tant en ce qui concerne la nécessité et la proportionnalité du système que les mesures d’atténuation retenues.

Conseil pratique : Conservez une trace écrite de toutes les étapes de l’AIDF. Des consultations menées, des avis recueillis, des décisions prises et des justifications apportées. Cette documentation sera précieuse en cas de contrôle ou de contestation ultérieure.

Contenu de l’Analyse d’Impact

L’IA Act définit un contenu minimal pour l’analyse d’impact sur les droits fondamentaux. L’AIDF doit inclure les éléments suivants.

Description du système d’IA et de son contexte d’utilisation

L’AIDF doit commencer par une description détaillée du système d’IA à haut risque et de son contexte d’utilisation. Cela inclut :

- La finalité du système et les objectifs poursuivis par son utilisation.

- Les modalités de fonctionnement du système, les données d’entrée et de sortie, les algorithmes utilisés.

- Le contexte géographique, temporel et fonctionnel dans lequel le système est destiné à être utilisé.

- Les catégories de personnes physiques susceptibles d’être affectées par l’utilisation du système.

- Les relations entre l’intégrateur et les fournisseurs ou autres acteurs impliqués.

Analyse approfondie : Cette description initiale est essentielle pour permettre aux lecteurs de l’AIDF de comprendre le fonctionnement du système. Et les enjeux spécifiques liés à son utilisation. Notamment aux autorités de contrôle et aux parties prenantes.

Identification des personnes et des groupes affectés

L’organisme responsable de l’AIDF doit identifier toutes les personnes et tous les groupes susceptibles d’être affectés, directement ou indirectement, par l’utilisation du système d’IA. Il doit accorder une attention particulière aux groupes vulnérables ou marginalisés, exposés à des risques accrus de discrimination ou d’exclusion.

Exemple concret : Un système d’IA est utilisé pour évaluer des demandes de logement social. L’AIDF doit identifier non seulement les demandeurs de logement eux-mêmes, mais aussi les membres de leur famille. Les voisins, les associations de locataires, etc. Elle doit aussi prendre en compte les impacts potentiels sur des groupes spécifiques. Comme les personnes handicapées, les familles monoparentales, les personnes issues de l’immigration, etc.

Évaluation des risques pour les droits fondamentaux

Le cœur de l’AIDF consiste en une évaluation approfondie et systématique des risques. Ceux que le système d’IA peut engendrer pour les droits fondamentaux. Cette évaluation doit couvrir l’ensemble des droits potentiellement affectés, tels que :

- Le droit à la non-discrimination, en identifiant les risques de biais discriminatoires. Dans les données, les algorithmes ou les résultats du système.

- Le droit au respect de la vie privée et familiale, en évaluant les risques d’intrusion dans la sphère privée. De surveillance disproportionnée ou de collecte et d’utilisation abusives de données personnelles.

- Le droit à la protection des données personnelles, en vérifiant la conformité du système avec les principes du RGPD. Et en identifiant les risques de violations de données ou d’atteintes à la sécurité des données.

- La liberté d’expression et d’information, en analysant les impacts potentiels du système sur la diffusion d’informations. Le pluralisme des opinions et le débat public.

- La liberté de réunion et d’association, en évaluant les risques de surveillance ou de restriction de ces libertés. Par exemple par le biais de systèmes de reconnaissance faciale dans l’espace public.

- Le droit à un recours effectif et à un procès équitable, en examinant dans quelle mesure le système d’IA peut affecter l’accès à la justice. L’équité des procédures judiciaires ou l’exercice des droits de la défense.

- Les droits sociaux et économiques, tels que le droit au travail, à l’éducation, à la santé ou à la protection sociale. En évaluant les impacts du système sur l’accès à ces droits et sur leur exercice effectif.

Analyse approfondie : L’évaluation des risques doit être menée de manière rigoureuse et méthodique. En s’appuyant sur des données probantes et en utilisant des outils d’analyse appropriés. Elle doit prendre en compte non seulement les risques directs et immédiats, mais aussi les risques indirects, cumulatifs et systémiques. Il est souvent utile de s’inspirer des méthodologies existantes en matière d’évaluation d’impact sur les droits humains. Telles que celles développées par les Nations Unies ou le Conseil de l’Europe.

Mesures de protection et de sauvegarde prévues

Pour chaque risque identifié, l’AIDF doit décrire les mesures de protection et de sauvegarde mises en place pour le prévenir ou l’atténuer. Ces mesures peuvent être de différentes natures :

- Mesures techniques, telles que l’utilisation de techniques de « privacy by design » ou de « fairness by design ». Le renforcement de la sécurité des données, l’anonymisation ou la pseudonymisation des données. La mise en place de mécanismes d’explicabilité ou d’auditabilité des algorithmes.

- Mesures organisationnelles, telles que la formation et la sensibilisation des personnels. La mise en place de procédures de contrôle humain, la création de comités d’éthique, la consultation des parties prenantes.

- Mesures juridiques, telles que l’adaptation des contrats avec les fournisseurs ou les utilisateurs. La mise en place de chartes éthiques, la souscription d’assurances spécifiques.

Conseil pratique : Les mesures de protection et de sauvegarde doivent être proportionnées aux risques identifiés. Et adaptées au contexte spécifique d’utilisation du système d’IA. Elles doivent être décrites de manière précise et concrète dans l’AIDF. En indiquant les responsabilités, les ressources et les calendriers de mise en œuvre.

Consultation des parties prenantes concernées

L’IA Act encourage les intégrateurs à consulter les parties prenantes concernées lors de la réalisation de l’AIDF. Cette consultation peut prendre différentes formes :

- Consultation des représentants des groupes de personnes susceptibles d’être affectées par le système. Afin de recueillir leurs points de vue, leurs préoccupations et leurs suggestions.

- Sollicitation d’avis d’experts indépendants, tels que des juristes, des éthiciens, des sociologues. Ou des spécialistes des droits fondamentaux.

- Consultation des organisations de la société civile actives dans la défense des droits humains. La protection des consommateurs ou d’autres domaines pertinents.

- Dialogue avec les partenaires sociaux, en particulier lorsque le système d’IA a un impact sur les conditions de travail ou l’emploi.

Analyse approfondie : La consultation des parties prenantes est un élément essentiel d’une AIDF de qualité. Elle permet d’enrichir l’analyse des risques et des impacts potentiels. D’identifier des aspects qui auraient pu être négligés par l’intégrateur. Et de concevoir des mesures d’atténuation plus efficaces et plus acceptables. Elle contribue également à renforcer la légitimité et la transparence du processus décisionnel.

Description du processus de surveillance et de suivi

L’AIDF doit décrire les mécanismes de surveillance et de suivi qui seront mis en place. Ceci pour évaluer l’efficacité des mesures d’atténuation des risques. Et pour détecter d’éventuels impacts négatifs imprévus du système d’IA sur les droits fondamentaux. Cela peut inclure :

- La mise en place d’indicateurs de performance relatifs au respect des droits fondamentaux.

- La réalisation d’audits réguliers du système et de ses impacts.

- La création de mécanismes de signalement et de plainte pour les personnes affectées par le système.

- La mise en place d’un processus de révision et d’actualisation de l’AIDF en fonction de l’évolution du système. Du contexte ou des connaissances sur les risques.

Conseil pratique : Le processus de surveillance et de suivi doit être proportionné aux risques identifiés. Et intégré dans le système de gestion des risques de l’intégrateur. Il doit faire l’objet d’une documentation appropriée et d’une communication transparente avec les parties prenantes.

Procédure et Délais

L’IA Act définit un certain nombre de règles procédurales concernant la réalisation et la communication de l’analyse d’impact sur les droits fondamentaux.

Réalisation de l’analyse avant la mise en service du système

L’organisme responsable doit effectuer l’AIDF avant la première mise en service du système d’IA à haut risque. Il doit la mener en parallèle avec l’évaluation des risques prévue par le système de gestion des risques. Ceci afin d’assurer une approche cohérente et globale de la gestion des risques.

Analyse approfondie :L’organisme responsable doit réaliser l’AIDF en amont du déploiement du système pour identifier et prendre en compte les risques pour les droits fondamentaux dès la phase de conception et de développement. Cette approche permet d’éviter des modifications coûteuses et complexes après la mise en service du système.

Transmission de l’analyse à l’autorité de surveillance du marché

Une fois l’AIDF réalisée, l’intégrateur doit la transmettre à l’autorité nationale de surveillance du marché. Avec une déclaration attestant que le système de gestion des risques de l’intégrateur est conforme aux exigences de l’IA Act. L’équipe en charge doit transmettre la version actualisée au plus tard quatre mois après la mise en service du système. Ou après le début du traitement des données à caractère personnel, si ce dernier intervient après la mise en service.

Dans le cas des opérateurs de services essentiels, la notification doit également inclure le plan de surveillance du système.

Conseil pratique : Anticipez les délais de transmission de l’AIDF et assurez-vous de disposer de tous les documents requis en temps voulu. N’hésitez pas à dialoguer avec l’autorité de surveillance du marché en amont de la transmission. Pour clarifier ses attentes et vous assurer de la conformité de votre analyse.

Publication d’un résumé de l’analyse

L’intégrateur doit publier un résumé de l’AIDF sur son site web ou, à défaut, le rendre accessible au public par d’autres moyens. Ce résumé doit inclure au moins :

- Une description du système d’IA et de sa finalité.

- Les catégories de personnes physiques susceptibles d’être affectées par l’utilisation du système.

- Les risques spécifiques pour les droits fondamentaux identifiés.

- Les mesures de protection et de sauvegarde prévues.

- Les coordonnées de l’intégrateur et les modalités d’exercice des droits par les personnes concernées.

Analyse approfondie : La publication d’un résumé de l’AIDF est une mesure importante de transparence. Elle permet aux personnes potentiellement affectées par le système d’IA, ainsi qu’à la société civile dans son ensemble, de comprendre les enjeux et les risques associés à son utilisation. Et d’exercer un contrôle démocratique sur le déploiement de ces technologies.

Actualisation de l’analyse en cas de changements substantiels

Il faut actualiser l’AIDF en cas de changements substantiels affectant le système d’IA, son contexte d’utilisation, ou lorsque le suivi révèle de nouveaux risques pour les droits fondamentaux. L’équipe en charge doit transmettre la version actualisée à l’autorité de surveillance du marché.

Exemple concret : L’entreprise étend un système d’IA initialement utilisé pour de l’analyse prédictive à de la prise de décision automatisée. Ou de nouvelles données scientifiques mettent en évidence des biais discriminatoires dans le système. L’organisme responsable devra alors actualiser l’AIDF pour refléter ces changements et leurs implications en termes de droits fondamentaux.

Liens avec le RGPD

L’analyse d’impact sur les droits fondamentaux présente des similitudes avec l’analyse d’impact relative à la protection des données (AIPD) prévue par le RGPD. Mais elle s’en distingue aussi par son champ d’application plus large et par son objectif spécifique.

Complémentarité avec l’analyse d’impact relative à la protection des données (AIPD)

L’AIPD est un processus visant à identifier et à minimiser les risques que peut engendrer un traitement de données personnelles pour la vie privée et les libertés individuelles. Elle est obligatoire pour les traitements susceptibles d’engendrer un risque élevé pour les droits et libertés des personnes concernées. Ce qui peut être le cas de nombreux systèmes d’IA.

L’AIDF et l’AIPD sont complémentaires : l’AIPD se concentre sur les risques liés à la protection des données personnelles. Tandis que l’AIDF couvre l’ensemble des droits fondamentaux potentiellement affectés par le système d’IA. Dans de nombreux cas, les deux analyses pourront être menées conjointement ou de manière coordonnée. Afin d’éviter les doublons et de garantir une approche cohérente.

Analyse approfondie : La complémentarité entre l’AIDF et l’AIPD reflète l’approche globale de l’IA Act. Qui vise à la fois à protéger les données personnelles et à garantir le respect de l’ensemble des droits fondamentaux dans le contexte de l’IA. Les intégrateurs doivent veiller à articuler ces deux instruments de manière cohérente et efficace.

Possibilité de réaliser une analyse conjointe

L’IA Act prévoit explicitement la possibilité de réaliser une analyse d’impact conjointe. Intégrant à la fois les exigences de l’AIDF et celles de l’AIPD. Cette approche peut permettre de rationaliser le processus d’évaluation des risques. Et de garantir une meilleure cohérence entre les mesures de protection des données et les mesures de protection des autres droits fondamentaux.

Conseil pratique : Si vous devez réaliser à la fois une AIDF et une AIPD pour un même système d’IA, envisagez de mener une analyse conjointe. En veillant à couvrir l’ensemble des exigences des deux réglementations. Vous pouvez vous appuyer sur les lignes directrices et les modèles fournis par les autorités de protection des données et les autorités de surveillance du marché pour structurer votre analyse.

Suites de l’Analyse d’Impact

La réalisation de l’AIDF n’est pas une fin en soi. Elle doit déboucher sur des actions concrètes pour prévenir ou atténuer les risques identifiés. Et pour garantir une utilisation du système d’IA respectueuse des droits fondamentaux.

Mise en œuvre des mesures d’atténuation

« L’intégrateur doit mettre en œuvre et assurer le suivi des mesures d’atténuation décrites dans l’AIDF tout au long du cycle de vie du système d’IA.

Analyse approfondie : La mise en œuvre des mesures d’atténuation est une étape cruciale pour garantir l’efficacité de l’AIDF. Elle nécessite un engagement fort de la part de l’intégrateur , des ressources suffisantes et une coordination étroite entre les différentes équipes impliquées (techniques, juridiques, éthiques, etc.).

Information des personnes concernées

L’intégrateur doit informer les personnes concernées par l’utilisation du système d’IA des résultats de l’AIDF. En particulier des risques identifiés pour leurs droits fondamentaux et des mesures prises pour les atténuer. Nous devons fournir cette information de manière claire, transparente et accessible

Exemple concret : Si une administration utilise un système d’IA pour évaluer les demandes de prestations sociales, elle doit informer les demandeurs des risques potentiels de discrimination ou d’erreur. Liés à l’utilisation de ce système. Des mesures prises pour prévenir ces risques, et des voies de recours possibles en cas de décision défavorable.

Dialogue avec les autorités de contrôle

L’intégrateur doit maintenir un dialogue ouvert et constructif avec les autorités de surveillance du marché. Concernant les résultats de l’AIDF et les mesures mises en œuvre. Il doit être prêt à répondre à leurs questions, à leur fournir des informations complémentaires. Et à adapter ses pratiques en fonction de leurs recommandations.

Conseil pratique : N’attendez pas d’être contrôlé pour dialoguer avec les autorités de surveillance du marché. Engagez le dialogue dès la phase de conception du système d’IA. Et sollicitez leur avis sur votre approche de l’analyse d’impact et de la gestion des risques.

Révision et actualisation de l’analyse

L’AIDF n’est pas un document figé. Elle doit être révisée et actualisée régulièrement. En fonction de l’évolution du système d’IA, du contexte d’utilisation, des connaissances sur les risques et des retours d’expérience. Une attention particulière doit être portée aux risques résiduels et aux impacts imprévus qui pourraient émerger après la mise en service du système.

Analyse approfondie : La révision et l’actualisation régulières de l’AIDF sont essentielles pour garantir son efficacité dans la durée. Elles permettent de s’adapter aux évolutions technologiques, réglementaires et sociétales. Et d’améliorer en continu la gestion des risques liés à l’IA.

Conclusion

L’analyse d’impact sur les droits fondamentaux est un instrument central de l’IA Act pour garantir une utilisation de l’intelligence artificielle respectueuse des droits humains et des valeurs démocratiques. Sa mise en œuvre effective représente un défi majeur pour les intégrateurs de systèmes d’IA à haut risque, mais aussi une opportunité de renforcer la confiance dans ces technologies et de promouvoir une innovation responsable.

Ensemble, relevons le défi d’une IA éthique, responsable et respectueuse des droits fondamentaux, pour faire de l’Europe un leader mondial de l’IA de confiance !

Sommaire

Chapitre 1 : Comprendre l’IA Act : Fondements et Objectifs

- Pourquoi une réglementation de l’IA ?

- Genèse de l’IA Act

- Objectifs et principes fondamentaux

- Champ d’application

- Définitions clés

- Approche basée sur les risques

Chapitre 2 : Les Risques Liés à l’Intelligence Artificielle : Un Enjeu Majeur

- Biais algorithmiques et discrimination

- Protection des données personnelles et vie privée

- Manipulation et désinformation

- Sécurité et robustesse des systèmes d’IA

- Impact sur l’emploi et le marché du travail

- Responsabilité et transparence

- Autres risques éthiques et sociétaux

Chapitre 3 : Classification des Risques selon l’IA Act : Une Approche Graduée

- Risque Inacceptable : Les Pratiques Interdites

- Haut Risque : Exigences Strictes pour les Systèmes Sensibles

- Risque Limité : Obligations de Transparence

- Risque Minimal : Pas d’Obligations Spécifiques

Chapitre 4 : Exigences Détaillées pour les Systèmes d’IA à Haut Risque

- Système de Gestion des Risques

- Gouvernance des Données

- Documentation Technique

- Tenue de Registres (Logging)

- Transparence et Information des Utilisateurs

- Contrôle Humain

- Exactitude, Robustesse et Cybersécurité

- Évaluation de la Conformité

- Déclaration de Conformité et Marquage CE

- Enregistrement dans la Base de Données de l’UE

Chapitre 5 : Étapes Pratiques pour se Conformer à l’IA Act

- Cartographie des Systèmes d’IA

- Évaluation des Risques

- Mise en Place d’un Système de Gestion des Risques

- Gouvernance des Données

- Documentation Technique

- Mise en Place du Contrôle Humain

- Évaluation de la Conformité

- Déclaration de Conformité et Marquage CE

- Enregistrement des Systèmes à Haut Risque

- Formation et Sensibilisation des Équipes

- Surveillance et Mise à Jour

Chapitre 6 : Spécificités pour Différents Types d’IA

- IA SaaS (ex. ChatGPT)

- Systèmes d’IA Développés en Interne

- Systèmes d’IA Fournis par un Tiers

- Agents IA Autonomes

- Modèles d’IA à Usage Général (GPAI)

Chapitre 7 : Sanctions en Cas de Non-Conformité avec l’IA Act

- Types d’Infractions

- Amendes Administratives

- Sanctions Non Pécuniaires

- Sanctions Spécifiques aux Fournisseurs de GPAI

- Facteurs Aggravants et Atténuants

- Adaptations pour les PME et les Startups

- Droit de Recours et Plaintes

- Surveillance et Contrôle

Chapitre 8 : Rôles et Responsabilités dans la Chaîne de Valeur de l’IA

- Fournisseurs de Systèmes d’IA

- intégrateurs de Systèmes d’IA

- Importateurs

- Distributeurs

- Mandataires

- Notion de Chaîne de Valeur et Interactions entre les Acteurs

Chapitre 9 : Rôle des États Membres et des Autorités de Contrôle

- Désignation des Autorités Compétentes

- Surveillance du Marché

- Mise en Place de Bacs à Sable Réglementaires

- Coopération avec les Institutions Européennes

- Sensibilisation, Formation et Soutien aux PME

- Autres Acteurs Impliqués

Chapitre 10 : Analyse d’Impact sur les Droits Fondamentaux

- Obligation pour les intégrateurs Publics et Certains Acteurs Privés

- Objectifs de l’Analyse d’Impact

- Contenu de l’Analyse d’Impact

- Procédure et Délais

- Liens avec le RGPD

- Suites de l’Analyse d’Impact

Chapitre 11 : Modèles d’IA à Usage Général (GPAI) et Risques Systémiques : Une Analyse Approfondie

- Définition des Modèles GPAI

- Obligations pour les Fournisseurs de GPAI

- GPAI Présentant un Risque Systémique

- Codes de Conduite pour les GPAI

- Rôle du Bureau de l’IA (AI Office)

- Enjeux de Conformité pour les Fournisseurs et les intégrateurs de GPAI

- Défis et Opportunités pour l’Innovation en IA