Introduction

L’intelligence artificielle progresse rapidement et transforme de nombreux secteurs. Les modèles d’IA à usage général (GPAI) jouent un rôle clé dans cette évolution. Ils génèrent du texte, analysent des images et facilitent la prise de décision. Leur polyvalence les rend incontournables, mais pose aussi des défis majeurs.

L’IA Act encadre ces modèles pour limiter les risques et garantir leur bon usage. Il impose des règles aux fournisseurs et définit des obligations strictes. Ce chapitre explique ces dispositions, les critères de risque et le rôle du Bureau de l’IA. Il détaille aussi les exigences de conformité et leurs impacts sur le marché.

Définition des Modèles GPAI

L’IA Act définit un modèle d’IA à usage général (GPAI) comme un système capable d’exécuter diverses tâches avec compétence.

Entraîné sur de grandes quantités de données, il peut s’intégrer dans plusieurs systèmes ou applications en aval.

Large spectre d’applications possibles

Contrairement aux systèmes d’IA traditionnels, souvent conçus pour une tâche spécifique (par exemple, la reconnaissance d’images, la traduction automatique, le diagnostic médical), les GPAI peuvent effectuer une grande variété de tâches. Dans des domaines potentiellement très divers (CNIL).

Exemple concret : Un grand modèle de langage comme GPT-4 peut générer du texte, répondre à des questions, traduire des langues, écrire différents types de contenus créatifs, résumer des documents, composer de la musique ou converser avec des utilisateurs. De surcroît, il peut être intégré dans des applications variées. Comme des chatbots, des assistants virtuels, des outils de rédaction assistée par ordinateur, des plateformes d’apprentissage en ligne, des systèmes de recherche d’information ou des jeux vidéo.

Capacité d’adaptation à différentes tâches

Les GPAI se distinguent par leur capacité d’adaptation à des tâches pour lesquelles ils n’ont pas été spécifiquement entraînés. Grâce à des techniques d’apprentissage avancées, comme l’apprentissage par transfert ou l’apprentissage « few-shot », ils généralisent leurs connaissances et leurs compétences à de nouveaux contextes.

Considérons un modèle de langage entraîné principalement sur des textes en anglais. Celui-ci peut être capable, avec un minimum d’ajustements, de générer du texte ou de répondre à des questions dans d’autres langues. De même, un modèle entraîné sur un corpus généraliste de textes et d’images peut être adapté pour effectuer des tâches spécialisées. Comme la rédaction d’articles juridiques ou la description d’images médicales, sans nécessiter un réentraînement complet.

Exemples : Modèles de langage (LLMs), modèles de génération d’images

Parmi les exemples les plus emblématiques de GPAI, on peut citer :

- Les grands modèles de langage (LLMs), tels que GPT-3 et GPT-4 d’OpenAI, BERT et LaMDA de Google, LLaMA de Meta, ou encore Claude d’Anthropic. Ces modèles génèrent du texte cohérent et pertinent dans une grande variété de styles et de formats. Ils répondent à des questions complexes, résument des documents, traduisent des langues, etc.

- Les modèles de génération d’images, tels que DALL-E 2 et Stable Diffusion d’OpenAI, Midjourney, ou encore Imagen de Google. Ces modèles créent des images réalistes ou artistiques à partir de descriptions textuelles. Ils modifient des images existantes, génèrent des variations d’images, etc.

- Les modèles multimodaux, qui combinent plusieurs types de données (texte, image, son, vidéo). De surcroît, ils effectuent des tâches impliquant différentes modalités sensorielles. Par exemple, un modèle multimodal pourrait générer une vidéo à partir d’un script textuel. Ou bien décrire le contenu d’une image en langage naturel. Ou encore répondre à des questions sur une vidéo.

En fait, la liste des GPAI n’est pas figée. Effectivement, elle est susceptible d’évoluer rapidement avec les progrès de la recherche en IA. Ainsi, de nouveaux types de modèles, avec des capacités encore plus étendues et plus polyvalentes, pourraient émerger dans les années à venir. L’IA Act vise à anticiper ces évolutions. Pour ce faire, elle adopte une définition large et technologiquement neutre des GPAI.

Exceptions

L’IA Act exclut de ses obligations spécifiques aux GPAI les modèles d’IA à usage général utilisés uniquement pour la recherche, le développement ou le prototypage avant leur mise sur le marché.

De même, il exempte les modèles mis à disposition sous licence libre et gratuite lorsqu’ils ne présentent pas de risque systémique. Toutefois, ces modèles restent soumis à l’obligation de transparence sur le contenu d’entraînement.

En premier lieu, si vous développez un GPAI à des fins de recherche, documentez soigneusement cette finalité. De surcroît, consignez les mesures prises pour éviter une mise sur le marché prématurée du modèle. En second lieu, si vous envisagez de diffuser votre modèle sous licence libre, évaluez attentivement les risques potentiels. Enfin, assurez-vous de respecter l’obligation de transparence sur les données d’entraînement.

Obligations pour les Fournisseurs de GPAI

Les fournisseurs de GPAI, qui développent ou font développer ces modèles avant de les mettre sur le marché ou en service, doivent respecter des obligations spécifiques.

Ces exigences sont proportionnées aux risques potentiels de ces technologies. Elles garantissent la transparence, la sécurité et le respect des droits fondamentaux tout au long du cycle de vie des GPAI.

Documentation technique détaillée

Premièrement, les fournisseurs de GPAI doivent constituer et tenir à jour une documentation technique détaillée de leur modèle, incluant notamment :

- Une description de l’architecture du modèle, des algorithmes utilisés, des paramètres clés et du processus d’entraînement.

- Des informations sur les données d’entraînement, y compris leur volume, leurs sources, leurs caractéristiques, les méthodes de collecte et de prétraitement, ainsi que les éventuelles limitations ou biais connus.

- Les résultats des tests et des évaluations effectués pour mesurer les performances du modèle, sa robustesse, sa sécurité et ses impacts potentiels, en particulier en termes de biais et de discrimination.

- Une description des mesures de gestion des risques mises en place, y compris les mesures de sécurité, de confidentialité et de contrôle humain.

- Le cas échéant, des informations sur la consommation énergétique du modèle et sur son empreinte environnementale.

La documentation technique d’un grand modèle de langage doit préciser ses paramètres, son architecture, son corpus d’entraînement et ses performances.

Elle inclut aussi les tests de toxicité, les biais détectés et les mesures de filtrage des contenus inappropriés ou illégaux.

Essentielle à la transparence, elle permet aux autorités, chercheurs et utilisateurs d’évaluer le modèle et d’identifier ses risques.

Fourniture d’informations aux utilisateurs en aval

Les fournisseurs de GPAI doivent mettre à la disposition des utilisateurs en aval qui souhaitent intégrer le modèle dans leurs propres systèmes d’IA un ensemble d’informations claires et complètes. Ainsi, ces derniers pourront utiliser le modèle de manière sûre, responsable et conforme à la loi. A ce propos, ces informations doivent inclure :

- Décrire les capacités et limites du modèle, ses performances, ses biais connus et les situations entraînant des erreurs.

- Recommander les usages appropriés et inappropriés en considérant les risques pour les droits fondamentaux, la sécurité et le bien-être.

- Fournir des instructions pour intégrer le modèle dans un système d’IA, incluant spécifications techniques, API et outils de développement.

- Indiquer les ressources nécessaires, comme la puissance de calcul, la mémoire et la bande passante.

- Proposer, si nécessaire, des orientations pour adapter ou affiner le modèle en respectant l’IA Act.

En fait, la fourniture d’informations claires et complètes aux utilisateurs en aval est essentielle pour prévenir les utilisations abusives ou dangereuses des GPAI. D’abord, les fournisseurs doivent s’assurer que ces informations sont facilement accessibles. Ensuite, ils veilleront à les rendre compréhensibles par des non-experts. Enfin, une mise à jour régulière de ces informations est cruciale, en fonction de l’évolution du modèle et des connaissances sur ses performances et ses risques.

Politique de respect du droit d’auteur

Les fournisseurs de GPAI doivent mettre en place et documenter une politique de respect du droit d’auteur, conformément à la directive européenne sur le droit d’auteur dans le marché unique numérique. En particulier, cette politique doit inclure :

- Des mécanismes pour identifier et documenter les œuvres protégées par le droit d’auteur qui sont utilisées pour l’entraînement du modèle, dans la mesure où ces informations sont publiquement accessibles.

- Des mesures techniques pour respecter les réserves de droits exprimées par les titulaires de droits, par exemple par le biais de métadonnées ou d’autres mécanismes de « opt-out ».

- Des procédures pour répondre aux demandes des titulaires de droits concernant l’utilisation de leurs œuvres dans l’entraînement du modèle.

En outre, les fournisseurs de GPAI doivent publier un résumé suffisamment détaillé du contenu utilisé pour l’entraînement du modèle. Ce résumé doit permettre aux titulaires de droits de comprendre quelles catégories d’œuvres protégées ont été utilisées et d’exercer leurs droits le cas échéant.

Il faut souligner que le respect du droit d’auteur est un enjeu majeur pour le développement des GPAI. En effet, ces derniers reposent souvent sur l’utilisation de grandes quantités de données textuelles ou visuelles potentiellement protégées. L’IA Act vise à trouver un équilibre. D’un côté, elle protège les intérêts légitimes des créateurs. De l’autre, elle permet de disposer de données suffisantes pour entraîner des modèles d’IA performants.

Publication d’un résumé sur le contenu utilisé pour l’entraînement

En complément de la politique de respect du droit d’auteur, les fournisseurs de GPAI doivent publier un résumé suffisamment détaillé du contenu utilisé pour l’entraînement de leur modèle. En effet, ce résumé doit permettre au public et aux titulaires de droits de comprendre la nature et l’origine des données utilisées. Cependant, il ne doit pas pour autant divulguer d’informations confidentielles ou de secrets commerciaux.

A titre d’illustration, le résumé pourrait indiquer les types de sources de données utilisées (par exemple, des sites web publics, des livres numérisés, des bases de données d’images, etc.), les langues et les domaines couverts par les données d’entraînement. De même, il pourrait mentionner les éventuelles mesures prises pour filtrer ou anonymiser les données.

La publication du résumé sur le contenu d’entraînement doit être intégrée dès la phase de conception du GPAI. Cela garantit une collecte et une documentation appropriées des données utilisées.

Il est également recommandé de consulter des experts juridiques pour assurer la conformité du processus. En effet, ceux-ci aideront à déterminer le niveau de détail optimal du résumé, en conciliant les exigences de transparence avec la protection des informations sensibles.

GPAI Présentant un Risque Systémique

L’IA Act introduit la notion de « risque systémique » pour qualifier les risques spécifiques liés aux GPAI les plus puissants et les plus influents. Un GPAI est considéré comme présentant un risque systémique lorsqu’il répond à certains critères. Ceux-ci seront précisés par la Commission européenne par voie d’actes délégués. Premièrement, ces critères tiendront compte de la quantité de calcul utilisée pour l’entraînement du modèle (exprimée en opérations en virgule flottante, ou FLOPS). Deuxièmement, ils prendront en considération ses capacités. Enfin, son impact sur le marché sera évalué. Par ailleurs, la Commission européenne pourra désigner un GPAI comme présentant un risque systémique sur la base d’une évaluation motivée. Même s’il ne remplit pas les critères quantitatifs.

Critères de détermination du risque systémique

La Commission européenne adoptera des actes délégués pour préciser les critères de détermination du risque systémique. D’abord, ces critères seront basés sur les indicateurs suivants (source) :

- Quantité de calcul utilisée pour l’entraînement du modèle : Les autorités définiront un seuil exprimé en FLOPS. Tout modèle nécessitant une quantité de calcul supérieure à ce seuil lors de son entraînement sera considéré comme présentant un risque systémique. Ce seuil sera régulièrement révisé pour s’adapter aux évolutions technologiques. Selon les informations disponibles lors de la rédaction de ce guide, il pourrait être fixé initialement à 10^25 FLOPS.

- Capacités du modèle : La Commission tiendra compte des capacités du modèle. Par exemple, elle considérera sa performance sur des benchmarks pertinents, sa polyvalence, sa capacité d’apprentissage autonome ou sa dangerosité potentielle.

- Impact sur le marché : En outre, la Commission évaluera l’impact du modèle sur le marché. Pour ce faire, elle tiendra compte notamment du nombre d’utilisateurs, de la diversité des secteurs d’application, de la dépendance d’autres acteurs vis-à-vis du modèle et de sa position sur le marché.

De nombreux experts soulignent que la quantité de calcul utilisée pour l’entraînement est un critère clé. Elle reflète directement la corrélation entre la puissance d’un modèle d’IA et les ressources informatiques mobilisées pour son développement.

Autrement dit, plus un modèle mobilise une grande quantité de calcul lors de son entraînement, plus ses capacités sont étendues. Son impact sur la société peut alors devenir significatif.

Obligations supplémentaires

Les fournisseurs de GPAI présentant un risque systémique seront soumis à des obligations supplémentaires. Proportionnées aux risques accrus liés à ces modèles. En effet, ces obligations visent à garantir un niveau de sécurité, de transparence et de responsabilité renforcé pour les GPAI les plus puissants et les plus influents.

Évaluation approfondie du modèle

En premier lieu, les fournisseurs de GPAI à risque systémique devront réaliser une évaluation approfondie de leur modèle. Incluant notamment :

- Une analyse détaillée des capacités et des limites du modèle. Pour ce faire, ils utiliseront des méthodologies d’évaluation avancées et des benchmarks pertinents.

- L’identification et l’évaluation des risques spécifiques liés au modèle. De surcroît, ils tiendront compte de son utilisation prévisible et de son mésusage raisonnablement prévisible.

- Des tests de confrontation (« adversarial testing ») pour évaluer la robustesse du modèle face à des attaques ou à des manipulations malveillantes.

- Une évaluation de l’efficacité des mesures d’atténuation des risques mises en place.

A titre d’exemple, pour un grand modèle de langage, l’évaluation approfondie pourrait inclure des tests spécifiques. Premièrement, on évaluerait sa propension à générer des contenus toxiques, discriminatoires ou trompeurs. Deuxièmement, on examinerait sa vulnérabilité aux attaques par injection de prompts malveillants. Enfin, on analyserait sa capacité à être utilisé pour de la désinformation à grande échelle.

De fait, l’évaluation approfondie doit être menée avec rigueur. En outre, elle doit s’appuyer sur des données probantes et utiliser des outils d’analyse appropriés.

Identification et atténuation des risques systémiques

Ensuite, sur la base de l’évaluation approfondie du modèle, les fournisseurs devront identifier et documenter les risques systémiques associés à leur GPAI. Ces risques peuvent inclure, par exemple :

- Les risques pour la sûreté et la sécurité des personnes, liés à une utilisation malveillante ou non intentionnelle du modèle (par exemple, pour la conception d’armes biologiques, la réalisation de cyberattaques ou la manipulation d’infrastructures critiques).

- Les risques pour la santé publique, liés à la diffusion de fausses informations médicales ou à la génération de contenus dangereux pour la santé mentale.

- Les risques pour les droits fondamentaux, tels que les biais discriminatoires, les atteintes à la vie privée, les restrictions à la liberté d’expression ou le renforcement des inégalités sociales.

- Les risques pour le fonctionnement des services essentiels, liés à la dépendance croissante de ces services vis-à-vis de l’IA et à la possibilité de défaillances en cascade.

- Les risques pour l’environnement, liés à la consommation énergétique élevée des grands modèles d’IA et à leur empreinte carbone.

De surcroît, pour chaque risque systémique identifié, les fournisseurs devront mettre en place des mesures d’atténuation appropriées. Ces mesures pourront inclure, par exemple :

- Des restrictions d’accès au modèle ou à certaines de ses fonctionnalités pour les utilisateurs non autorisés ou pour des usages à haut risque.

- Des mécanismes de filtrage ou de modération des contenus générés par le modèle, afin de limiter la diffusion de contenus illégaux, préjudiciables ou contraires à l’éthique.

- Des procédures de signalement et de traitement des incidents ou des abus liés à l’utilisation du modèle.

- Des mesures de transparence renforcées, telles que la publication d’informations détaillées sur les performances du modèle, ses limites et ses biais potentiels.

- La mise en place de mécanismes de contrôle humain pour les utilisations les plus sensibles du modèle.

Il faut souligner que l’identification et l’atténuation des risques systémiques sont des processus complexes et itératifs. En effet, ils nécessitent une expertise multidisciplinaire et une coopération étroite entre les fournisseurs de GPAI, les chercheurs, les régulateurs et la société civile. De plus, les mesures d’atténuation doivent être proportionnées aux risques identifiés, tout en préservant dans la mesure du possible les bénéfices et les usages légitimes du modèle.

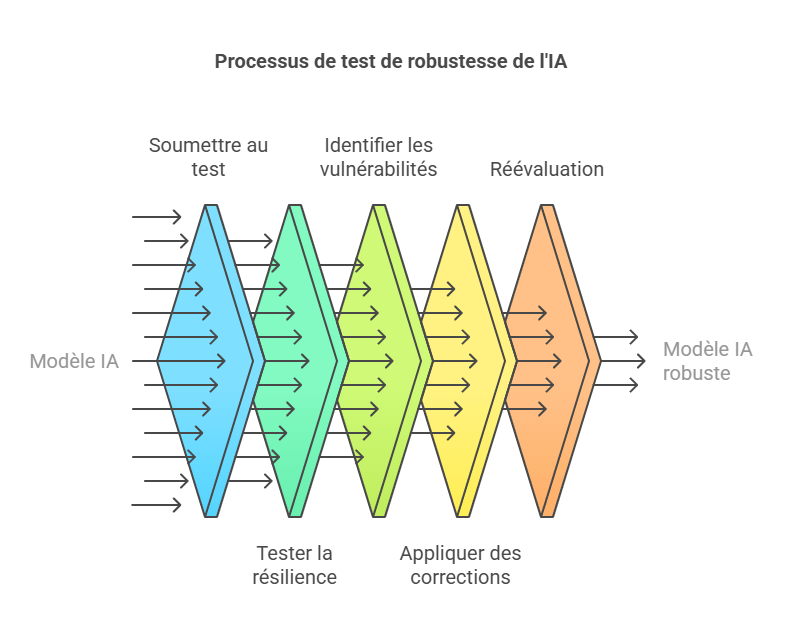

Tests de confrontation (« adversarial testing »)

De surcroît, les fournisseurs de GPAI à risque systémique devront soumettre leur modèle à des tests de confrontation (« adversarial testing »). Ainsi, ils évalueront sa robustesse et sa résilience face à des attaques ou à des manipulations malveillantes. Ces tests consistent à essayer de mettre en défaut le modèle en lui fournissant des entrées (« prompts ») spécialement conçues pour le tromper, le faire dysfonctionner ou lui faire produire des résultats indésirables.

A titre d’illustration, pour un modèle de langage, les tests de confrontation pourraient consister à essayer de lui faire générer des contenus haineux, discriminatoires ou violents. Ou bien, on pourrait tenter de lui faire révéler des informations confidentielles sur ses données d’entraînement. Enfin, on pourrait le manipuler pour qu’il produise de fausses informations ou qu’il adopte un comportement dangereux.

Il est à noter que les tests de confrontation doivent être réalisés par des experts en sécurité de l’IA. En effet, ceux-ci utilisent des méthodologies rigoureuses et des outils spécialisés. De plus, ils doivent être répétés régulièrement, en particulier après des mises à jour majeures du modèle. Ainsi, on s’assure de sa robustesse dans le temps.

Mesures de cybersécurité renforcées

En raison de leur puissance et de leur potentiel impact sur la société, les GPAI à risque systémique doivent faire l’objet de mesures de cybersécurité renforcées. En effet, les fournisseurs doivent mettre en place des protections appropriées. Ainsi, ils préviendront les accès non autorisés au modèle, le vol ou la fuite de données, les modifications malveillantes du modèle ou de son comportement, et les attaques par déni de service.

Comme l’illustre de nombreux experts en sécurité, la cybersécurité des GPAI est un enjeu crucial. Effectivement, elle concerne tant pour les fournisseurs que pour les utilisateurs et la société dans son ensemble. En fait, une compromission de ces modèles pourrait avoir des conséquences graves. Par exemple, elle permettrait à des acteurs malveillants de les utiliser pour générer des contenus illégaux ou préjudiciables à grande échelle, mener des cyberattaques sophistiquées ou accéder à des informations sensibles.

Signalement des incidents graves à la Commission

Signaler immédiatement à la Commission européenne tout incident grave lié à l’utilisation du modèle. Inclure les incidents affectant les droits fondamentaux, la sécurité, le bien-être ou le fonctionnement des services essentiels. Informer la Commission des mesures correctives prises ou prévues pour résoudre l’incident et en limiter les impacts.

Prenons le cas d’un modèle de langage utilisé pour générer de fausses informations à caractère politique. Supposons que ces informations soient largement diffusées sur les réseaux sociaux et menacent de perturber le déroulement d’une élection. Alors, le fournisseur du modèle doit signaler cet incident à la Commission. En outre, il doit coopérer avec les autorités compétentes pour en limiter l’impact.

Afin d’attirer l’attention sur l’importance de cette mesure, mettez en place des procédures internes claires pour la détection, l’analyse et le signalement des incidents graves impliquant vos GPAI. D’abord, désignez un point de contact responsable de la communication avec la Commission européenne. Ensuite, assurez-vous qu’il dispose des informations et des ressources nécessaires pour agir rapidement et efficacement en cas d’incident.

Information sur la consommation énergétique du modèle

Afin de promouvoir la transparence et la responsabilité environnementale, les fournisseurs de GPAI à risque systémique doivent documenter et, le cas échéant, rapporter la consommation énergétique de leur modèle tout au long de son cycle de vie. Ils doivent notamment fournir des informations sur :

- La quantité d’énergie utilisée pour l’entraînement initial du modèle. Ainsi que pour les éventuelles phases de réentraînement ou d’adaptation.

- Les sources d’énergie utilisées (renouvelables ou non renouvelables) et l’empreinte carbone associée.

- Les mesures d’efficacité énergétique mises en place lors de la conception, du développement et du déploiement du modèle.

De toute évidence, la consommation énergétique des grands modèles d’IA est un enjeu croissant. Effectivement, elle concerne tant d’un point de vue environnemental qu’économique. C’est pourquoi, en exigeant des fournisseurs de GPAI à risque systémique qu’ils documentent et rapportent ces informations, l’IA Act vise à encourager le développement de modèles plus sobres et plus durables. De surcroît, elle sensibilise les utilisateurs à l’impact environnemental de ces technologies.

Codes de Conduite pour les GPAI

L’IA Act encourage les fournisseurs de GPAI à élaborer des codes de conduite pour faciliter l’application des exigences. Ils travailleront avec la Commission européenne, les autorités nationales, la société civile et d’autres parties prenantes.. Ils pourront couvrir un large éventail d’aspects, tels que :

- La gestion des risques liés aux GPAI, y compris les risques systémiques.

- La qualité et la sécurité des données utilisées pour l’entraînement des modèles.

- La transparence et l’explicabilité des modèles.

- La robustesse et la cybersécurité des modèles.

- La prévention et l’atténuation des biais discriminatoires.

- Le respect du droit d’auteur et des droits de propriété intellectuelle.

- La protection de la vie privée et des données personnelles.

- La durabilité environnementale des modèles, notamment en termes de consommation énergétique.

- Les mécanismes de recours et de réparation pour les utilisateurs et les personnes affectées par les GPAI.

Élaboration de codes de conduite au niveau de l’UE

L’UE, sous l’égide du Bureau de l’IA (AI Office) de la Commission européenne, élaborera les codes de conduite pour les GPAI. Ensuite, la Commission les approuvera après consultation du Comité européen de l’intelligence artificielle et des parties prenantes concernées.

De fait, l’élaboration de codes de conduite au niveau de l’UE vise à garantir une approche harmonisée et cohérente de la gouvernance des GPAI dans l’ensemble du marché unique. En outre, elle permettra de mutualiser les expertises et les bonnes pratiques. Enfin, elle favorisera l’émergence de normes communes pour le développement et l’utilisation responsables de ces technologies.

Couverture des obligations de l’IA Act

Les codes de conduite devront couvrir l’ensemble des obligations applicables aux fournisseurs de GPAI en vertu de l’IA Act. Notamment, les exigences spécifiques aux modèles à risque systémique. Ils pourront préciser et compléter ces obligations, en proposant par exemple des méthodologies d’évaluation des risques, des modèles de documentation technique, des bonnes pratiques en matière de transparence ou des mécanismes de labellisation éthique.

En premier lieu, impliquez-vous activement dans l’élaboration des codes de conduite. Ainsi, vous ferez valoir vos points de vue. De plus, vous vous assurerez que les exigences proposées sont à la fois ambitieuses en termes de protection des droits fondamentaux et réalistes d’un point de vue opérationnel.

Prise en compte des spécificités des PME

Par ailleurs, les responsables de l’élaboration des codes de conduite devront accorder une attention particulière aux besoins et aux contraintes spécifiques des PME et des startups. L’objectif est de veiller à ce qu’elles ne soient pas pénalisées de manière disproportionnée par rapport aux grands acteurs du marché. A ce propos, les codes de conduite pourront prévoir des obligations simplifiées pour les PME. De même, ils proposeront des outils d’auto-évaluation adaptés à leur taille, ou des mécanismes de soutien et d’accompagnement spécifiques.

Il est indéniable que la prise en compte des spécificités des PME est essentielle pour garantir la compétitivité et la diversité du marché européen de l’IA. En effet, elle vise à éviter que la réglementation ne crée des barrières à l’entrée trop élevées pour les petits acteurs. De surcroît, elle ne doit pas favoriser une concentration excessive du marché entre les mains de quelques grandes entreprises.

Présomption de conformité pour les fournisseurs respectant un code approuvé

Les fournisseurs de GPAI qui adhèrent à un code de conduite approuvé par la Commission et qui en respectent les dispositions bénéficieront d’une présomption de conformité avec les exigences correspondantes de l’IA Act. En d’autres termes, les autorités de contrôle considéreront a priori que ces fournisseurs respectent leurs obligations, sauf preuve contraire.

Prenons le cas d’un code de conduite approuvé qui prévoit des exigences spécifiques en matière de documentation technique des GPAI. Alors, un fournisseur qui respecte ces exigences sera présumé conforme à l’obligation de documentation technique prévue par l’IA Act. De ce fait, il n’aura pas à le démontrer à nouveau.

En fait, l’adhésion à un code de conduite approuvé peut constituer un avantage significatif pour les fournisseurs de GPAI. Premièrement, elle simplifie leurs démarches de conformité. Deuxièmement, elle leur apporte une plus grande sécurité juridique. Enfin, elle peut être un gage de confiance pour les utilisateurs et les partenaires commerciaux.

Rôle du Bureau de l’IA (AI Office)

Le Bureau de l’IA (AI Office), créé au sein de la Commission européenne, jouera un rôle central dans la surveillance et la gouvernance des GPAI. En particulier des modèles à risque systémique. Il sera chargé de :

Surveillance des GPAI, en particulier ceux à risque systémique

Le Bureau de l’IA aura pour mission de surveiller le marché des GPAI. D’identifier les modèles présentant un risque systémique et de suivre leur évolution dans le temps. Pour ce faire, il pourra demander aux fournisseurs de GPAI toute information nécessaire à l’exercice de cette mission. Notamment, il aura accès à la documentation technique, aux données d’entraînement et au code du modèle dans des conditions encadrées et pour des motifs justifiés.

De fait, la surveillance proactive des GPAI par le Bureau de l’IA est essentielle pour anticiper les risques émergents. De même, elle est cruciale pour adapter la réglementation en fonction de l’évolution rapide de ces technologies. En outre, elle permettra de mieux comprendre les impacts sociétaux des GPAI et d’éclairer les choix politiques en la matière.

Élaboration de lignes directrices et de bonnes pratiques

En s’appuyant sur l’expertise technique et scientifique disponible, le Bureau de l’IA élaborera des lignes directrices et des recommandations. Ainsi, il aidera les fournisseurs de GPAI à se conformer à leurs obligations. De surcroît, il contribuera à l’élaboration de normes harmonisées et de spécifications communes pour les GPAI. En coopération avec les organismes de normalisation européens et internationaux.

A titre d’exemple, le Bureau de l’IA pourrait publier des lignes directrices sur les méthodologies d’évaluation des risques pour les GPAI. Ou bien, il pourrait proposer des bonnes pratiques en matière de transparence et d’explicabilité. Enfin, il pourrait formuler des recommandations sur les mesures de sécurité à mettre en place pour prévenir les utilisations malveillantes de ces modèles.

Pouvoir d’enquête et de demande d’informations

D’abord, en cas de suspicion de non-conformité ou de risque grave lié à un GPAI, le Bureau de l’IA pourra mener des enquêtes. Ensuite, il pourra demander aux fournisseurs concernés de lui fournir toutes les informations nécessaires. Notamment, il pourra exiger l’accès à la documentation technique, aux données d’entraînement, aux résultats des tests d’évaluation et de confrontation. De même, il pourra demander toute autre information pertinente pour évaluer la conformité et les risques du modèle.

Si un fournisseur refuse de coopérer ou transmet des informations incomplètes ou trompeuses, le Bureau de l’IA pourra lui imposer des sanctions administratives.

Les autorités pourront également infliger des amendes pouvant atteindre 1,5 % du chiffre d’affaires annuel mondial de l’exercice précédent. Si ce montant est plus élevé, l’amende pourra aller jusqu’à 7,5 millions d’euros.

En premier lieu, les fournisseurs de GPAI doivent se préparer à répondre aux demandes d’information du Bureau de l’IA. De même, ils doivent coopérer pleinement avec ses enquêtes. En second lieu, ils ont intérêt à mettre en place des mécanismes internes pour collecter, organiser et mettre à jour les informations relatives à leurs modèles. Ainsi, ils pourront répondre rapidement et efficacement aux sollicitations du Bureau.

Évaluation des codes de conduite et des normes harmonisées

Le Bureau de l’IA sera chargé d’évaluer les codes de conduite élaborés pour les GPAI. Ensuite, il recommandera à la Commission de les approuver ou non. De plus, il contribuera à l’élaboration de normes harmonisées pour les GPAI. Enfin, il évaluera leur pertinence au regard des exigences de l’IA Act.

Il faut souligner que l’implication du Bureau de l’IA dans l’évaluation des codes de conduite et des normes harmonisées vise à garantir leur qualité, leur cohérence avec les objectifs de l’IA Act et leur adéquation aux spécificités des GPAI. De surcroît, elle permettra d’assurer une certaine harmonisation des pratiques d’auto-régulation et de normalisation au niveau européen.

Enjeux de Conformité pour les Fournisseurs et les Déployeurs de GPAI

La mise en conformité avec les exigences spécifiques aux GPAI représente un défi majeur pour les fournisseurs de ces modèles. De même, les acteurs qui les intègrent dans leurs systèmes ou applications en aval sont concernés.

Charge de la preuve et documentation

En premier lieu, les fournisseurs de GPAI, en particulier ceux à risque systémique, devront être en mesure de démontrer la conformité de leurs modèles avec l’ensemble des exigences applicables. En conséquence, cela implique une charge de la preuve importante. Notamment, il faudra constituer une documentation technique exhaustive, réaliser des évaluations des risques et des tests approfondis. De surcroît, il faudra mettre en place des mécanismes de gouvernance et de surveillance robustes.

Afin de bien vous préparer, anticipez la charge de travail liée à la documentation et à l’évaluation de la conformité dès les phases de conception et de développement de vos GPAI. En outre, mettez en place des processus internes pour collecter et organiser les informations nécessaires. Enfin, n’hésitez pas à vous faire accompagner par des experts juridiques et techniques spécialisés dans l’IA.

Articulation entre les obligations des fournisseurs et celles des déployeurs

Certes, les fournisseurs de GPAI ont des obligations spécifiques. Cependant, les déployeurs qui intègrent ces modèles dans leurs propres systèmes d’IA à haut risque ne sont pas exemptés de responsabilités. En effet, ils doivent notamment s’assurer que le GPAI qu’ils utilisent est approprié à la finalité de leur système. De plus, ils doivent vérifier que les données d’entrée sont pertinentes et de qualité suffisante. Enfin, ils doivent s’assurer que les performances et les limites du modèle sont compatibles avec les exigences de sécurité et de respect des droits fondamentaux applicables à leur système.

Il faut dire aussi que l’articulation entre les obligations des fournisseurs et celles des déployeurs de GPAI est un point crucial pour garantir l’efficacité de l’IA Act. En effet, les déployeurs ne peuvent pas se contenter de se fier aveuglément aux informations fournies par les fournisseurs. Au contraire, ils doivent effectuer leurs propres évaluations et prendre leurs propres responsabilités en matière de conformité.

Gestion des risques tout au long de la chaîne de valeur

La mise en conformité des GPAI est l’affaire de toute la chaîne de valeur. En effet, cela concerne les fournisseurs initiaux, les utilisateurs finaux, les intégrateurs, les distributeurs et les autres intermédiaires. En fait, chaque acteur doit prendre ses responsabilités pour identifier, évaluer et atténuer les risques liés à l’utilisation de ces modèles. Bien sûr, cela doit se faire en tenant compte de son rôle spécifique et de son niveau de contrôle sur la technologie.

Afin de bien gérer les risques, mettez en place des mécanismes de communication et de coopération avec les autres acteurs de la chaîne de valeur. Ainsi, vous pourrez partager les informations sur les risques, coordonner les mesures d’atténuation et clarifier les responsabilités de chacun. De surcroît, des contrats bien rédigés, prévoyant des clauses spécifiques sur la conformité des GPAI, seront essentiels pour formaliser ces relations.

Adaptation continue aux évolutions technologiques et réglementaires

D’abord, le domaine des GPAI est en constante et rapide évolution. Ensuite, les chercheurs et les entreprises développent régulièrement de nouveaux modèles dotés de capacités et d’architectures toujours plus sophistiquées, puis les mettent sur le marché. Par ailleurs, les autorités et les organismes de normalisation font évoluer la réglementation et les normes techniques pour les adapter à ces avancées technologiques. En conséquence, les acteurs de la chaîne de valeur des GPAI doivent faire preuve d’une grande agilité et d’une capacité d’adaptation permanente pour maintenir leur conformité dans la durée.

Il faut dire que la mise en conformité des GPAI n’est pas un exercice ponctuel. En réalité, c’est un processus continu, qui exige une veille technologique et réglementaire constante. De plus, il requiert une évaluation régulière des risques et une mise à jour fréquente des mesures de gestion des risques et de la documentation technique.

Défis et Opportunités pour l’Innovation en IA

L’encadrement des GPAI par l’IA Act soulève des défis importants pour les acteurs de l’IA. En particulier, en termes de charge de conformité, de complexité technique et d’incertitude juridique. Cependant, il offre aussi des opportunités pour promouvoir une innovation plus responsable, plus sûre et plus respectueuse des valeurs européennes.

Un cadre juridique exigeant mais nécessaire

Les exigences pour les GPAI, surtout ceux à risque systémique, comptent parmi les plus strictes de l’IA Act. Elles imposent aux fournisseurs des obligations lourdes en évaluation des risques, documentation, transparence et sécurité. Leur mise en œuvre exigera des investissements conséquents en ressources humaines et infrastructures techniques.

Il est indéniable que le caractère exigeant du cadre juridique applicable aux GPAI reflète la prise de conscience par le législateur européen des risques potentiels associés à ces technologies. Mais aussi de leur importance stratégique pour l’avenir de l’économie et de la société. En fait, l’objectif est de trouver un juste équilibre entre la prévention des risques et la promotion de l’innovation. En d’autres termes, il s’agit de créer un environnement propice au développement d’une IA européenne digne de confiance.

Des opportunités pour une IA plus responsable et plus sûre

En revanche, en encadrant le développement et l’utilisation des GPAI, l’IA Act vise à promouvoir une IA plus responsable, plus sûre et plus respectueuse des droits fondamentaux. Les exigences de transparence, de documentation et d’évaluation des risques doivent permettre de mieux comprendre le fonctionnement de ces modèles. De même, elles doivent aider à mieux identifier leurs limites et leurs biais potentiels. Enfin, elles doivent contribuer à mieux maîtriser leurs impacts sur les individus et sur la société.

A titre d’exemple, l’obligation de réaliser des tests de confrontation pour les GPAI à risque systémique doit permettre de mieux évaluer leur robustesse face à des attaques et à des manipulations. Ainsi, on renforcera leur sécurité. De même, les exigences en matière de documentation technique et d’information des utilisateurs en aval doivent contribuer à une plus grande transparence. En outre, elles favoriseront une meilleure appropriation de ces technologies par l’ensemble des acteurs concernés.

Un potentiel d’innovation accru par la confiance

D’abord, en créant un cadre juridique clair et prévisible pour le développement et l’utilisation des GPAI, l’IA Act vise à renforcer la confiance des utilisateurs, des investisseurs et de la société dans son ensemble envers ces technologies. Ensuite, cette confiance accrue pourrait se traduire par une adoption plus large et plus rapide des GPAI. Enfin, cela ouvrirait ainsi la voie à de nouvelles applications et à de nouveaux services innovants.

Il faut dire que les entreprises qui sauront anticiper et intégrer les exigences de l’IA Act dans leur stratégie de développement des GPAI pourront non seulement se prémunir contre les risques juridiques et réputationnels. Mais aussi se différencier sur le marché en proposant des modèles plus sûrs, plus transparents et plus respectueux des valeurs éthiques. En d’autres termes, la conformité peut devenir un avantage concurrentiel et un moteur d’innovation.

La nécessité d’une coopération internationale

Premièrement, les GPAI sont des technologies globales. En effet, elles dépassent les frontières et soulèvent des enjeux communs à l’ensemble de la communauté internationale. Deuxièmement, si l’IA Act constitue une avancée majeure dans la régulation de ces technologies, une coopération internationale sera indispensable pour relever les défis qu’elles posent à l’échelle mondiale.

Une approche harmonisée de la régulation des GPAI au niveau international permettrait d’éviter les fragmentations réglementaires. De plus, elle favoriserait la mutualisation des efforts de recherche et de développement sur les aspects de sécurité et d’éthique. Enfin, elle encouragerait des normes communes pour une IA responsable et digne de confiance. C’est pourquoi l’Union européenne a un rôle important à jouer pour promouvoir une telle approche. Pour ce faire, elle peut s’appuyer sur l’exemple de l’IA Act et dialoguer avec ses partenaires internationaux.

Conclusion

L’encadrement des modèles d’IA à usage général (GPAI) est l’une des innovations majeures et les plus ambitieuses de l’IA Act. En effet, en soumettant ces technologies puissantes et polyvalentes à des exigences spécifiques, proportionnées à leurs capacités et à leurs impacts potentiels, le législateur européen a voulu anticiper et prévenir les risques systémiques qu’elles pourraient engendrer. En même temps, il a cherché à préserver leur potentiel d’innovation.

La mise en œuvre des exigences des GPAI représente un défi majeur pour les fournisseurs et les utilisateurs. Ils devront adapter leurs pratiques, leurs processus et leurs technologies pour respecter ce nouveau cadre réglementaire. Cela nécessitera des investissements, une coopération accrue et une adaptation continue aux évolutions technologiques et législatives. Cependant, cet encadrement favorise une IA plus sûre, transparente et respectueuse des droits fondamentaux. L’IA Act veut créer un climat de confiance et libérer le potentiel d’innovation des GPAI. Il ambitionne de faire de l’Europe un leader mondial de l’IA digne de confiance.

Sommaire

Chapitre 1 : Comprendre l’IA Act : Fondements et Objectifs

- Pourquoi une réglementation de l’IA ?

- Genèse de l’IA Act

- Objectifs et principes fondamentaux

- Champ d’application

- Définitions clés

- Approche basée sur les risques

Chapitre 2 : Les Risques Liés à l’Intelligence Artificielle : Un Enjeu Majeur

- Biais algorithmiques et discrimination

- Protection des données personnelles et vie privée

- Manipulation et désinformation

- Sécurité et robustesse des systèmes d’IA

- Impact sur l’emploi et le marché du travail

- Responsabilité et transparence

- Autres risques éthiques et sociétaux

Chapitre 3 : Classification des Risques selon l’IA Act : Une Approche Graduée

- Risque Inacceptable : Les Pratiques Interdites

- Haut Risque : Exigences Strictes pour les Systèmes Sensibles

- Risque Limité : Obligations de Transparence

- Risque Minimal : Pas d’Obligations Spécifiques

Chapitre 4 : Exigences Détaillées pour les Systèmes d’IA à Haut Risque

- Système de Gestion des Risques

- Gouvernance des Données

- Documentation Technique

- Tenue de Registres (Logging)

- Transparence et Information des Utilisateurs

- Contrôle Humain

- Exactitude, Robustesse et Cybersécurité

- Évaluation de la Conformité

- Déclaration de Conformité et Marquage CE

- Enregistrement dans la Base de Données de l’UE

Chapitre 5 : Étapes Pratiques pour se Conformer à l’IA Act

- Cartographie des Systèmes d’IA

- Évaluation des Risques

- Mise en Place d’un Système de Gestion des Risques

- Gouvernance des Données

- Documentation Technique

- Mise en Place du Contrôle Humain

- Évaluation de la Conformité

- Déclaration de Conformité et Marquage CE

- Enregistrement des Systèmes à Haut Risque

- Formation et Sensibilisation des Équipes

- Surveillance et Mise à Jour

Chapitre 6 : Spécificités pour Différents Types d’IA

- IA SaaS (ex. ChatGPT)

- Systèmes d’IA Développés en Interne

- Systèmes d’IA Fournis par un Tiers

- Agents IA Autonomes

- Modèles d’IA à Usage Général (GPAI)

Chapitre 7 : Sanctions en Cas de Non-Conformité avec l’IA Act

- Types d’Infractions

- Amendes Administratives

- Sanctions Non Pécuniaires

- Sanctions Spécifiques aux Fournisseurs de GPAI

- Facteurs Aggravants et Atténuants

- Adaptations pour les PME et les Startups

- Droit de Recours et Plaintes

- Surveillance et Contrôle

Chapitre 8 : Rôles et Responsabilités dans la Chaîne de Valeur de l’IA

- Fournisseurs de Systèmes d’IA

- intégrateurs de Systèmes d’IA

- Importateurs

- Distributeurs

- Mandataires

- Notion de Chaîne de Valeur et Interactions entre les Acteurs

Chapitre 9 : Rôle des États Membres et des Autorités de Contrôle

- Désignation des Autorités Compétentes

- Surveillance du Marché

- Mise en Place de Bacs à Sable Réglementaires

- Coopération avec les Institutions Européennes

- Sensibilisation, Formation et Soutien aux PME

- Autres Acteurs Impliqués

Chapitre 10 : Analyse d’Impact sur les Droits Fondamentaux

- Obligation pour les intégrateurs Publics et Certains Acteurs Privés

- Objectifs de l’Analyse d’Impact

- Contenu de l’Analyse d’Impact

- Procédure et Délais

- Liens avec le RGPD

- Suites de l’Analyse d’Impact

Chapitre 11 : Modèles d’IA à Usage Général (GPAI) et Risques Systémiques : Une Analyse Approfondie

- Définition des Modèles GPAI

- Obligations pour les Fournisseurs de GPAI

- GPAI Présentant un Risque Systémique

- Codes de Conduite pour les GPAI

- Rôle du Bureau de l’IA (AI Office)

- Enjeux de Conformité pour les Fournisseurs et les intégrateurs de GPAI

- Défis et Opportunités pour l’Innovation en IA